تکنیک یادگیری عمیق براساس اختلاط دو روش S-Mask R-CNN و Inception-v3

چکیده

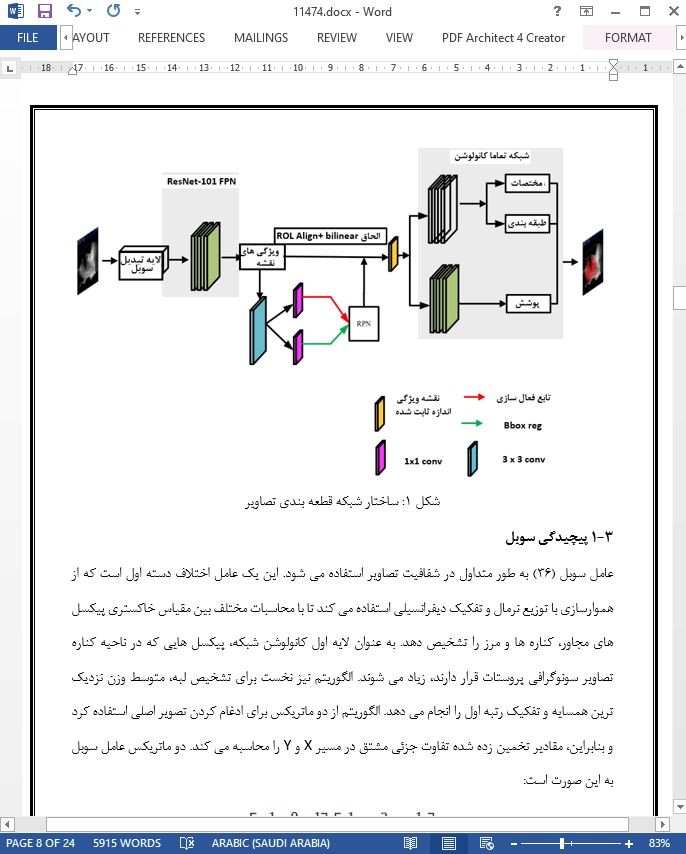

تشخیص تصاویر سونوگرافی پروستات به کمک کامپیوتر می تواند به کشف بیماری و درمان سرطان پروستات کمک کند. با این وجود تصاویر سونوگرافی که از پروستات به دست می آید گاهی با نقطه های صوتی سنگین، نسبت پایین سیگنال به صدا و دقت پایین بررسی همراه می باشد. به منظور فائق آمدن بر این نقص، ما مدل تکنیک یادگیری عمیق را در این مقاله مطرح کردیم که S-Mask R-CNN و Inception-v3 را در تشخیص بیماری سرطان پروستات به کمک تصاویر سونوگرافی با یکدیگر ادغام می کند. از S-Mask R-CNN برای درک دقیق قطعه بندی تصاویر سونوگرافی پروستات و تکثیر مناطق منتخب استفاده شد. برای درک نقطه جایگاه یابی در ویژگی های پیکسل از تراز الگوریتم برای منطقه مورد نظر استفاده شده است. ویژگی های پوشش باینری یا دوتایی (یک اصطلاح تخصصی در مهندسی کامپیوتر می باشد) در تصاویر پروستات توسط شبکه پیچیده ای برای قطعه بندی ناحیه پروستات و زمینه آن به وجود آمده است. سپس، اطلاعات زمینه ای ذخیره شد، و مجموعه اطلاعات مربوط به تصاویر قطعه بندی شده سونوگرافی پروستات، برای شبکه Inception-v3 به منظور شناسایی آسیب ساخته شد. طرح شبکه جدید اضافه شد تا جایگزین رده بندی اصلی نمونه باشد، که این شبکه از گسترش به جلو و عقب تشکیل شده است. گسترش رو به جلو اساسا ویژگی های استخراج شده از لایه پیچیده، لایه مشترک و زیر لایه مشترک سوم را به لایه درونی منتقل می کند و این کار را از طریق تکنیک یادگیری انتقال انجام می دهد و سپس مقادیر کاهش یافته بین طبقه بندی ها و مقادیر علامت دار را محاسبه می کند تا سونوگرافی آسیب پروستات را تشخیص دهد. نتایج پیشنهادی نشان داد که روش مطرح شده می تواند به طور دقیق تصاویر سونوگرافی پروستات و اطلاعات قطعه بندی پروستات را در سطح پیکسل به طور همزمان مشخص نماید. این روش پیشنهاد شده نسبت به تشخیصی که پزشکان بطور دستی انجام می دهند و نیز دیگر روش های تشخیص بیماری، دارای دقت بالاتری است. روش ساده و کارآمد ما به عنوان مبنای شروع بسیار قابل اطمینان عمل می کند و منجر به تسهیل تحقیقات آینده در تشخیص یارانه ای تصاویر سونوگرافی پروستات می شود. گذشته از این، این عملیات، پیشرفت تکنولوژی های تشخیص سونوگرافی را در سرطان پروستات موجب می شود.

7- نتیجه گیری

مدل یادگیری عمیق که S-Mask R-CNN و Inception-v3 را در تشخیص سرطان پروستات به کمک تصاویر سونوگرافی یکپارچه می کند، در این مقاله مطرح شده است. مجموعه ای از تصاویر سونوگرافی پروستات با قطعه بندی و طبقه بندی ساخته شد و روش مطرح شده در این مقاله در این دستگاه آموزش داده شد. این مدل شبکه برای به دست آوردن جایگاه یابی صحیح نقاط ویژگی در تصاویر سونوگرافی پروستات از الگوریتم ROIAlign استفاده می کند. شبکه ترکیب شده ResNet-101 و RPN موجب بهبودی دقت قطعه بندی شده است، و پوشش باینری تصاویر سونوگرافی پروستات، از طریق FCN ایجاد شد تا به تاثیر قطعه بندی تصاویر و ناحیه پس زمینه دست یابد. طبقه بندی مدل اصلی لایه softmax، با مدل شبکه دسته بندی Inception-v3 جایگزین می شود (لایه softmax به لایه آخر میگن که خروجی لایه قبل رو میگیرد). بر اساس تست مقایسه ای، هر مدل شبکه قدیمی، روش استفاده شده در این مقاله می تواند کشف و تشخیص بیماری را بهبود بخشد بدون اینکه در محاسبات و مدل، افزایش قابل توجهی در پیچیدگی دیده شود. گام بعدی؛ گسترش دادن مجموعه اطلاعات حاضر و استفاده از الگوریتم درون یابی خطی مکعبی است که جایگزین الگوریتم درون یابی دو خطی می باشد و به منظور پیشرفت و بهبود دقت قطعه بندی می باشد و از این رو بهبود اثرات آن بر تشخیص بهبود می یابد. براساس تحقیقات حاضر، این مدل در زمینه سه بعدی به حد مطلوب و بهینه رسید و مورد استفاده قرار گرفت.

Abstract

The computer-aided diagnosis of prostate ultrasound images can aid in the detection and treatment of prostate cancer. However, the ultrasound images of the prostate sometimes come with serious speckle noise, low signal-to-noise ratio, and poor detection accuracy. To overcome this shortcoming, we proposed a deep learning model that integrates S-Mask R-CNN and Inception-v3 in the ultrasound image-aided diagnosis of prostate cancer in this paper. The improved S-Mask R-CNN was used to realize the accurate segmentation of prostate ultrasound images and generate candidate regions. The region of interest align algorithm was used to realize the pixel-level feature point positioning. The corresponding binary mask of prostate images was generated by the convolution network to segment the prostate region and the background. Then, the background information was shielded, and a data set of segmented ultrasound images of the prostate was constructed for the Inception-v3 network for lesion detection. A new network model was added to replace the original classification module, which is composed of forward and back propagation. Forward propagation mainly transfers the characteristics extracted from the convolution layer pooling layer below the pool_3 layer through the transfer learning strategy to the input layer and then calculates the loss value between the classified and label values to identify the ultrasound lesion of the prostate. The experimental results showed that the proposed method can accurately detect the ultrasound image of the prostate and segment prostate information at the pixel-level simultaneously. The proposed method has higher accuracy than that of the doctor’s manual diagnosis and other detection methods. Our simple and effective approach will serve as a solid baseline and help ease future research in the computer-aided diagnosis of prostate ultrasound images. Furthermore, this work will promote the development of prostate cancer ultrasound diagnostic technology.

7. Conclusion

A deep learning model that integrates S-Mask R-CNN and Inception-v3 in ultrasound image-aided diagnosis of prostate cancer was proposed in this paper. A set of ultrasonic images of the prostate with segmentation and classification were constructed, and the model of this paper was trained on the set. This network model used the ROIAlign algorithm to achieve accurate positioning of feature points in prostate ultrasound images. The combined ResNet-101 and RPN networks improved the segmentation accuracy, and the corresponding binary mask of prostate ultrasound images was generated through FCN to achieve the segmentation effect of the prostate and background regions. The original model classification softmax layer was replaced with an improved Inception-v3 classification network model. Based on the comparison test of each classical network model, the method used in this paper can improve the detection without significantly increasing the complexity of calculation and model. The next step is to expand the current data set and use cubic linear interpolation algorithm instead of bilinear interpolation algorithm to improve the segmentation accuracy and thus improve the effect of model detection. Based on existing research, the model was optimized and applied to the 3D field.

چکیده

1- معرفی

2- عملیات مرتبط

3- قطعه بندی تصاویر

3-1 پیچیدگی سوبل

3-2 شبکه RPN

3-3 لایه ROIAlign

3-4 تابع شکست

3-5 شبکه پیچشی کامل

4- طبقه بندی تصاویر

4-1 واحد Inception

4-2 توابع هزینه اختلاف آنتروپی

4-3 حذف تصادفی

4-4 تعلیم مدل شبکه

4-5 شاخص های سنجش نتایج طبقه بندی

5- مجموعه اطلاعات و ساختار محیط تجربی

5-1 مجموعه اطلاعات

5-2 تنظیمات پارامترها

6- نتایج آزمایش

6-1 آنالیز تشخیص

6-3 آنالیز نتایج

7- نتیجه گیری

abstract

1. Introduction

2. Related work

3. Image segmentation

3.1. Sobel convolution

3.2. RPN network

3.3. ROIAlign layer

3.4. Loss function

3.5. Full convolutional network

4. Image classification

4.1. Inception module

4.2. Cross-entropy cost function

4.3. Dropout

4.4. Network model training

4.5. Classification result evaluation indicators

5. Data set and experimental environment construction

5.1. Data set

5.2. Parameter settings

6. Experimental results

6.1. Detection analysis

6.2. Building the effectiveness of the different data set analysis

6.3. Results analysis

7. Conclusion

- ترجمه فارسی مقاله با فرمت ورد (word) با قابلیت ویرایش، بدون آرم سایت ای ترجمه

- ترجمه فارسی مقاله با فرمت pdf، بدون آرم سایت ای ترجمه