دانلود رایگان پایان نامه تصمیم گیری هوشمند توسط هوش مصنوعی لبه برای شهرهای هوشمند

قدردانی iii

فهرست جداول viii

فهرست اشکال ix

فصل 1

مقدمه 1

1.1 مشارکت 4

1.2 نقشه راه پایان نامه 5

فصل 2

قرار دادن سرویسهای یادگیری عمیق با آگاهی از QoS در لبه با پیادهسازی چندین سرویس 6

2.1 مقدمه 7

2.2 آثار مرتبط 8

2.3 سیستم مدل 10

2.3.1 تعریف معماری سیستم 10

2.3.2 تعریف کیفیت خدمات (QoS) 11

2.4 تعریف مسئله 13

2.4.1 فرمولاسیون PIES 14

2.4.2 پیچیدگی مشکل و ویژگی های PIES 14

2.5 طراحی الگوریتم کارآمد 18

2.5.1 زمانبندی فرعی مسئله 19

2.5.2 قرار دادن مسئله فرعی 19

2.6 طراحی تجربی و نتایج 22

2.6.1 خطوط مبنا 22

2.6.2 شبیه سازی عددی 22

2.6.3 پیاده سازی در دنیای واقعی 24

2.7 نتیجه گیری 25

فصل 3

تصمیمات فشرده سازی و بارگذاری مشترک برای خدمات یادگیری عمیق در سیستم های لبه سه لایه 26

3.1 مقدمه 27

3.2 کارهای مرتبط 28

3.3 طراحی سیستم و کد تعریف مسئله 29

3.3.1 معماری سیستم 3 لایه 30

3.3.2 فشرده سازی و دقت یادگیری ماشین 30

3.3.3 کد تعریف مسئله 31

3.3.4 تعریف میانگین دقت و تأخیر 32

3.4 تجزیه مسئله و طراحی اکتشافی 34

3.4.1 طراحی الگوریتم کارآمد 35

3.5 طراحی تجربی 37

3.5.1 الگوریتم های معیار/ابتکار 38

3.5.2 راه اندازی محیط 39

3.6 نتایج 40

3.6.1 تأثیر Amin & Lmax بر مقدار هدف 41

3.6.2 تأثیر α بر تصمیمات فشرده سازی (ها) و مقدار هدف 41

3.6.3 تأثیر منابع سخت افزاری 43

3.7 نتیجه گیری 43

فصل 4

چارچوبی برای شبکه های توزیع هوشمند لبه از طریق یادگیری فدرال 44

4.1 مقدمه 45

4.2 شبکه های توزیع هوشمند و زیرساخت اندازه گیری پیشرفته 46

4.2.1 بررسی اجمالی و الزامات AMI 47

4.2.2 توابع AMI و NILM 48

4.3 Edge Intelligence برای Smart Grids 49

4.3.1 نمای کلی و معماری EC 49

4.3.2 Edge Intelligence 51

4.3.3 یادگیری فدرال 51

4.4 NILM مبتنی بر FL مدل 53

4.4.1 طراحی مدل شبکه عصبی عمیق 53

4.4.2 آموزش فدرال 2 سطحی و 3 سطحی 54

4.5 طراحی آزمایش 55

4.5.1 شرح داده 55

4.5.2 مدل ارتباطی 56

4.6 نتایج و بحث 57

4.6.1 تجزیه و تحلیل بار شبکه 57

4.6.2 عملکرد مدل آموزش دیده 59

4.7 نتیجه گیری و جهت گیری های آینده 60

فصل 5

چراغهای راهنمایی هوشمند دارای لبههای هوشمند با استفاده از یادگیری تقویتی فدرال برای تبادل پاداش-ارتباطات 61

5.1 مقدمه 62

5.2 شرح سیستم 64

5.3 تعریف مدل SEAL پیشنهادی 65

5.3.1 فضای عمل 66

5.3.2 فضای حالت 67

5.3.3 تابع پاداش 68

5.3.4 مدل ارتباطی 69

5.4 الگوریتم های آموزشی 69

5.4.1 آموزش متمرکز 70

5.4.2 آموزش غیرمتمرکز 71

5.4.3 آموزش فدرال 71

5.5 طراحی آزمایش 73

5.5.1 توپولوژی های شبکه جاده ای در نظر گرفته شده 73

5.5.2 پارامترهای آموزشی 74

5.6 نتایج و بحث 74

5.6.1 ارزیابی پاداش در طول آموزش 75

5.6.2 ارزیابی هزینه ارتباطات در طول آموزش 75

5.6.3 عملکرد شبکه سیاست آموزش دیده 77

5.7 آثار مرتبط 78

5.8 نتیجه گیری 79

فصل 6

نتیجه گیری و اظهارات پایانی 80

6.1 یافته ها 80

6.2 کار آینده 81

کتابشناسی 83

ویتا 100

چکیده پایان نامه

شهرهای هوشمند یک چشم انداز بلندپروازانه برای محیط های شهری آینده هستند. هدف نهایی شهرهای هوشمند استفاده از فناوری مدرن برای بهینهسازی منابع و عملیات شهری و در عین حال بهبود کلی کیفیت زندگی شهروندان است. تحقق این چشم انداز بلندپروازانه مستلزم پذیرش پیشرفت در فناوری ارتباطات اطلاعات، تجزیه و تحلیل داده ها و سایر فناوری ها است. از آنجایی که شهرهای هوشمند به طور طبیعی مقادیر زیادی داده تولید میکنند، تکنیکهای هوش مصنوعی اخیر (AI) به دلیل توانایی آنها در تبدیل دادههای خام به دانش روشنتر برای تصمیمگیری (مثلاً استفاده از دادههای ترافیک جادهای زنده برای کنترل چراغهای راهنمایی بر اساس ترافیک فعلی مورد توجه هستند. شرایط). با این حال، آموزش و ارائه این برنامه های کاربردی هوش مصنوعی غیر ضروری است و به منابع محاسباتی کافی نیاز دارد. به طور سنتی، از زیرساختهای محاسبات ابری برای پردازش وظایف محاسباتی فشرده استفاده میشود؛ با این حال، به دلیل حساسیت زمانی بسیاری از این برنامههای کاربردی شهر هوشمند، سختافزار/فناوریهای محاسباتی جدید مورد نیاز است. ظهور اخیر محاسبات لبه، زیرساخت محاسباتی امیدوارکننده ای را برای پشتیبانی از نیازهای شهرهای هوشمند فردا فراهم می کند. محاسبات لبه، منابع محاسباتی را به کاربران نهایی نزدیک میکند تا تأخیر کمتر و مقیاسپذیری بهبود یافته را ارائه دهد - و آن را به یک نامزد مناسب برای پشتیبانی از شهرهای هوشمند تبدیل میکند. با این حال، با محدودیت های سخت افزاری همراه است که باید در نظر گرفته شود.

این پایان نامه به بررسی استفاده از الگوی محاسبات لبه برای برنامه های کاربردی شهر هوشمند و چگونگی اتخاذ تصمیمات کارآمد و هوشمند مرتبط با منابع موجود می پردازد. این با در نظر گرفتن کیفیت خدمات ارائه شده به کاربران نهایی انجام می شود. این اثر در چهار قسمت قابل مشاهده است. ابتدا، این کار به چگونگی قرار دادن و ارائه بهینه برنامههای مبتنی بر هوش مصنوعی در زیرساختهای محاسباتی لبهای برای به حداکثر رساندن کیفیت خدمات برای کاربران نهایی میپردازد. این به عنوان یک مسئله بهینه سازی ریخته می شود و با الگوریتم های کارآمد که جواب بهینه را تقریب می کند حل می شود. دوم، این کار کاربرد تکنیکهای فشردهسازی را برای کاهش هزینههای تخلیه برای برنامههای مبتنی بر هوش مصنوعی در سیستمهای محاسباتی لبه بررسی میکند. در نهایت، این پایان نامه سپس نشان می دهد که چگونه محاسبات لبه می تواند از راه حل های مبتنی بر هوش مصنوعی برای برنامه های کاربردی شهر هوشمند، یعنی انرژی هوشمند و ترافیک هوشمند پشتیبانی کند. این برنامه ها با استفاده از پارادایم اخیر یادگیری فدرال مورد بررسی قرار می گیرند. مشارکتهای این پایاننامه شامل طراحی الگوریتمهای جدید و استراتژیهای طراحی سیستم برای قرار دادن و زمانبندی سرویسهای مبتنی بر هوش مصنوعی در سیستمهای محاسباتی لبهای، فرمولبندی رسمی برای معاوضه بین عملکرد مدل هوش مصنوعی ارائهشده و تأخیر، فشردهسازی برای تصمیمگیریهای تخلیه بار برای کاهش ارتباطات است. و ارزیابی رویکردهای مبتنی بر یادگیری فدرال برای کاربردهای شهر هوشمند.

ABSTRACT OF DISSERTATION

Smart cities are an ambitious vision for future urban environments. The ultimate aim of smart cities is to use modern technology to optimize city resources and operations while improving overall quality-of-life of its citizens. Realizing this ambitious vision will require embracing advancements in information communication technology, data analysis, and other technologies. Because smart cities naturally produce vast amounts of data, recent artificial intelligence (AI) techniques are of interest due to their ability to transform raw data into insightful knowledge to inform decisions (e.g., using live road traffic data to control traffic lights based on current traffic conditions). However, training and providing these AI applications is non-trivial and will require sufficient computing resources. Traditionally, cloud computing infrastructure have been used to process computationally intensive tasks; however, due to the time-sensitivity of many of these smart city applications, novel computing hardware/technologies are required. The recent advent of edge computing provides a promising computing infrastructure to support the needs of the smart cities of tomorrow. Edge computing pushes compute resources close to end users to provide reduced latency and improved scalability — making it a viable candidate to support smart cities. However, it comes with hardware limitations that are necessary to consider.

This thesis explores the use of the edge computing paradigm for smart city applications and how to make efficient, smart decisions related to their available resources. This is done while considering the quality-of-service provided to end users. This work can be seen as four parts. First, this work touches on how to optimally place and serve AI-based applications on edge computing infrastructure to maximize quality-of-service to end users. This is cast as an optimization problem and solved with efficient algorithms that approximate the optimal solution. Second, this work investigates the applicability of compression techniques to reduce offloading costs for AI-based applications in edge computing systems. Finally, this thesis then demonstrate how edge computing can support AI-based solutions for smart city applications, namely, smart energy and smart traffic. These applications are approached using the recent paradigm of federated learning. The contributions of this thesis include the design of novel algorithms and system design strategies for placement and scheduling of AI-based services on edge computing systems, formal formulation for trade-offs between delivered AI model performance and latency, compression for offloading decisions for communication reductions, and evaluation of federated learning-based approaches for smart city applications.

Acknowledgments iii

List of Tables viii

List of Figures ix

Chapter 1

Introduction 1

1.1 Contribution 4

1.2 Roadmap of the Thesis 5

Chapter 2

QoS-Aware Placement of Deep Learning Services on the Edge with Multiple Service Implementations 6

2.1 Introduction 7

2.2 Related Works 8

2.3 System Model 10

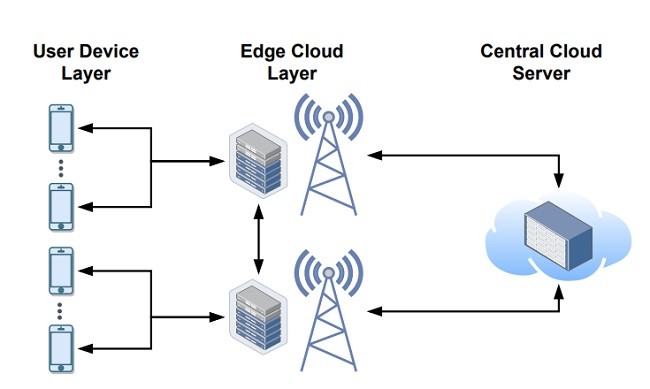

2.3.1 System Architecture Definition 10

2.3.2 Quality-of-Service (QoS) Definition 11

2.4 Problem Definition 13

2.4.1 PIES Formulation 14

2.4.2 PIES Problem Complexity & Properties 14

2.5 Efficient Algorithm Design 18

2.5.1 Scheduling Sub-Problem 19

2.5.2 Placement Sub-Problem 19

2.6 Experimental Design & Results 22

2.6.1 Baselines 22

2.6.2 Numerical Simulations 22

2.6.3 Real-World Implementation 24

2.7 Conclusions 25

Chapter 3

Joint Compression and Offloading Decisions for Deep Learning Services in 3-Tier Edge Systems 26

3.1 Introduction 27

3.2 Related Work 28

3.3 System Design & CODE Problem Definition 29

3.3.1 3-Tier System Architecture 30

3.3.2 Compression and Machine Learning Accuracy 30

3.3.3 CODE Problem Definition 31

3.3.4 Defining Average Accuracy & Latency 32

3.4 Problem Decomposition & Heuristic Design 34

3.4.1 Efficient Algorithm Design 35

3.5 Experimental Design 37

3.5.1 Benchmark Algorithms/Heuristics 38

3.5.2 Environment Setup 39

3.6 Results 40

3.6.1 Impact of Amin & Lmax on the Objective Value 41

3.6.2 Impact of α on Compression Decisions (s) and the Objective Value 41

3.6.3 Impact of Hardware Resources 43

3.7 Conclusions 43

Chapter 4

A Framework for Edge Intelligent Smart Distribution Grids via Federated Learning 44

4.1 Introduction 45

4.2 Smart Distribution Grids & Advanced Metering Infrastructure 46

4.2.1 AMI Overview and Requirements 47

4.2.2 AMI Functions and NILM 48

4.3 Edge Intelligence for Smart Grids 49

4.3.1 EC Overview and Architecture 49

4.3.2 Edge Intelligence 51

4.3.3 Federated Learning 51

4.4 FL-Based NILM Model 53

4.4.1 Deep Neural Network Model Design 53

4.4.2 2-Tier & 3-Tier Federated Learning 54

4.5 Experiment Design 55

4.5.1 Data Description 55

4.5.2 Communication Model 56

4.6 Results & Discussion 57

4.6.1 Network Load Analysis 57

4.6.2 Trained Model Performance 59

4.7 Conclusions & Future Directions 60

Chapter 5

Smart Edge-Enabled Traffic Lights Using Federated Reinforcement Learning for Reward-Communication Trade-Off 61

5.1 Introduction 62

5.2 System Description 64

5.3 Proposed SEAL Model Definition 65

5.3.1 Action Space 66

5.3.2 State Space 67

5.3.3 Reward Function 68

5.3.4 Communication Model 69

5.4 Training Algorithms 69

5.4.1 Centralized Training 70

5.4.2 Decentralized Training 71

5.4.3 Federated Training 71

5.5 Experiment Design 73

5.5.1 Considered Road Network Topologies 73

5.5.2 Training Parameters 74

5.6 Results & Discussion 74

5.6.1 Reward Evaluation During Training 75

5.6.2 Communication Cost Evaluation During Training 75

5.6.3 Trained Policy Network Performance 77

5.7 Related Works 78

5.8 Conclusions 79

Chapter 6

Conclusions & Final Remarks 80

6.1 Findings 80

6.2 Future Work 81

Bibliography 83

Vita 100